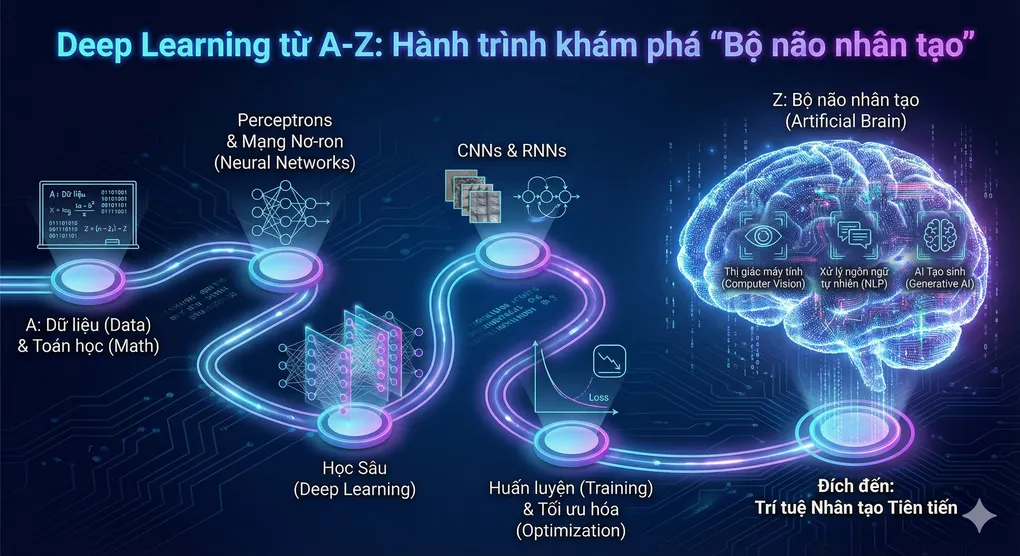

Deep Learning từ A-Z: Hành trình khám phá "Bộ não nhân tạo"

Lời mở đầu

Chào mọi người! Mình là sinh viên năm cuối ngành Công nghệ phần mềm. Sau gần 4 năm học và làm việc với AI/Machine Learning, hôm nay mình muốn chia sẻ về Deep Learning - một trong những công nghệ “hot” nhất hiện nay nhưng cũng khá “huyền bí” với nhiều người.

Bạn có bao giờ thắc mắc:

- 🤔 Làm sao ChatGPT có thể trò chuyện như con người?

- 🤔 Tại sao iPhone nhận diện khuôn mặt bạn trong chớp mắt?

- 🤔 Tesla tự lái xe như thế nào?

Tất cả đều nhờ vào Deep Learning! Và tin vui là, những khái niệm cốt lõi không khó hiểu như bạn nghĩ đâu.

🧠 Deep Learning là gì?

Định nghĩa đơn giản

Deep Learning (Học sâu) là một nhánh của Machine Learning, sử dụng mạng nơ-ron nhân tạo nhiều lớp (deep neural networks) để học từ dữ liệu.

Nghe có vẻ phức tạp? Hãy tưởng tượng đơn giản:

Deep Learning giống như cách bộ não con người học: Thay vì lập trình cứng nhắc “nếu A thì B”, chúng ta cho máy tính xem hàng ngàn ví dụ và để nó tự tìm ra quy luật.

So sánh với Machine Learning truyền thống

Để hiểu rõ hơn, hãy xem sự khác biệt:

Machine Learning truyền thống:

- Cần con người thiết kế features (đặc trưng) thủ công

- Ví dụ: Nhận diện chữ số → Phải tự thiết kế cách trích xuất nét viết, góc cạnh…

- Hiệu quả với dữ liệu đơn giản

Deep Learning:

- Tự động học features từ dữ liệu thô

- Ví dụ: Cho ảnh chữ số → Model tự học cách nhận diện nét, góc, hình dạng

- Cực kỳ mạnh với dữ liệu phức tạp (ảnh, âm thanh, văn bản)

🏗️ Kiến trúc cơ bản: Neural Network

1. Neuron nhân tạo - “Tế bào não”

Hãy tưởng tượng một neuron (nơ-ron) như một “hộp đen nhỏ”:

Input 1 ──→ [Weight 1]

Input 2 ──→ [Weight 2] ──→ [NEURON] ──→ Output

Input 3 ──→ [Weight 3] ↓

[Activation]Cách hoạt động:

- Nhận nhiều inputs (đầu vào)

- Mỗi input có một weight (trọng số) - độ quan trọng

- Tính tổng có trọng số:

sum = (input1 × weight1) + (input2 × weight2) + ... - Áp dụng activation function (hàm kích hoạt)

- Cho ra output (đầu ra)

Ví dụ thực tế: Nhận diện ảnh có chứa mèo hay không:

- Input 1: Độ “nhọn” của tai → Weight cao (mèo có tai nhọn)

- Input 2: Màu lông → Weight thấp (mèo có nhiều màu)

- Input 3: Hình dạng mắt → Weight cao (mèo có mắt đặc trưng)

2. Mạng nhiều lớp (Deep Neural Network)

Deep trong Deep Learning có nghĩa là nhiều lớp:

Input Layer → Hidden Layer 1 → Hidden Layer 2 → ... → Output Layer

(Ảnh) (Cạnh, nét) (Hình dạng) (Dự đoán)Mỗi lớp học một cấp độ trừu tượng:

Ví dụ nhận diện khuôn mặt:

- Lớp 1 (thấp): Phát hiện cạnh, góc đơn giản

- Lớp 2: Kết hợp thành các bộ phận (mắt, mũi, miệng)

- Lớp 3: Kết hợp thành khuôn mặt hoàn chỉnh

- Lớp output: Nhận diện “Đây là người X”

3. Tại sao gọi là “Deep”?

- Shallow (Nông): 1-2 lớp ẩn

- Deep (Sâu): 3+ lớp ẩn, có thể lên đến hàng trăm lớp!

VGG16 (model nhận diện ảnh nổi tiếng): 16 lớp

ResNet152: 152 lớp

GPT-3 (ChatGPT): 96 lớp với 175 tỷ tham số!

📚 Quá trình “Học” của Deep Learning

1. Forward Propagation (Lan truyền tiến)

Đây là quá trình dự đoán:

- Đưa dữ liệu vào Input Layer

- Dữ liệu “chảy” qua các lớp

- Mỗi neuron tính toán và truyền tiếp

- Cuối cùng ra Output (dự đoán)

Ví dụ: Đưa ảnh con mèo vào → Model dự đoán “Mèo: 85%“

2. Loss Function (Hàm mất mát)

Sau khi dự đoán, cần đánh giá sai bao nhiêu:

- Dự đoán: “Mèo: 85%”

- Thực tế: “Mèo: 100%” (đúng là mèo)

- Loss (độ sai): 0.15

Loss càng nhỏ → Model càng chính xác

3. Backpropagation (Lan truyền ngược)

Đây là “ma thuật” của Deep Learning:

- Tính Loss (độ sai)

- Truyền ngược từ output về input

- Tính xem neuron nào “đóng góp” vào sai sót

- Điều chỉnh weights (trọng số) để giảm Loss

Quá trình này lặp lại hàng nghìn lần (epochs) cho đến khi model học “thuộc bài”.

4. Optimization (Tối ưu hóa)

Gradient Descent - Thuật toán tối ưu phổ biến nhất:

Tưởng tượng bạn đang ở trên núi trong màn sương (không nhìn thấy gì):

- Mục tiêu: Xuống tới chân núi (điểm Loss thấp nhất)

- Cách làm: Từng bước nhỏ, luôn đi theo hướng dốc xuống

- Learning rate (tốc độ học): Độ lớn của mỗi bước

Nếu bước quá lớn → Có thể nhảy qua điểm tối ưu

Nếu bước quá nhỏ → Mất nhiều thời gian

🎯 Các loại Deep Learning phổ biến

1. Convolutional Neural Networks (CNN)

Chuyên môn: Xử lý ảnh

Đặc điểm:

- Sử dụng filters (bộ lọc) để quét qua ảnh

- Phát hiện patterns cục bộ (cạnh, góc, texture)

- Giảm kích thước dữ liệu qua pooling

Ứng dụng:

- Nhận diện khuôn mặt (Face ID)

- Phát hiện đối tượng (xe tự lái)

- Chẩn đoán y tế (phát hiện ung thư từ X-quang)

- Nhận diện chữ viết tay (như dự án Kanji của mình!)

Ví dụ thực tế: Model của mình nhận diện chữ Kanji chính là một CNN 3 lớp, đạt 99.14% accuracy!

2. Recurrent Neural Networks (RNN) & LSTM

Chuyên môn: Dữ liệu tuần tự (sequence data)

Đặc điểm:

- Có memory (bộ nhớ) - nhớ thông tin từ bước trước

- Xử lý dữ liệu có thứ tự (văn bản, âm thanh, video)

Ứng dụng:

- Dịch máy (Google Translate)

- Nhận diện giọng nói (Siri, Alexa)

- Dự đoán chuỗi thời gian (giá cổ phiếu)

- Tạo văn bản tự động

Vấn đề: RNN đơn giản gặp khó với chuỗi dài → Sinh ra LSTM (Long Short-Term Memory)

3. Transformer & Attention Mechanism

Chuyên môn: Xử lý ngôn ngữ tự nhiên (NLP)

Đột phá: Self-Attention - Model học cách “chú ý” vào phần quan trọng

Ví dụ: Câu: “Con mèo của tôi rất thông minh. Nó thích ăn cá.”

- Attention giúp model hiểu “Nó” = “Con mèo”

Ứng dụng:

- BERT (Google): Hiểu ngữ cảnh văn bản

- GPT (OpenAI): ChatGPT, tạo văn bản

- T5: Dịch thuật, tóm tắt

Sức mạnh: Xử lý song song (không cần tuần tự như RNN) → Nhanh hơn, chính xác hơn

4. Generative Adversarial Networks (GAN)

Chuyên môn: Tạo dữ liệu mới

Cơ chế: Hai mạng “đối đầu” nhau:

- Generator (Bên tạo): Tạo dữ liệu giả

- Discriminator (Bên phân biệt): Phân biệt thật/giả

Giống như trò chơi “mèo vờn chuột”:

- Generator cố tạo ảnh giả càng giống thật càng tốt

- Discriminator cố phát hiện ảnh giả

- Qua nhiều vòng → Generator tạo ảnh cực kỳ realistic

Ứng dụng:

- Tạo khuôn mặt người (thispersondoesnotexist.com)

- Deepfake

- Chuyển đổi phong cách nghệ thuật

- Tạo ảnh từ văn bản (DALL-E, Stable Diffusion)

5. Autoencoders

Chuyên môn: Nén và giải nén dữ liệu

Cấu trúc:

- Encoder: Nén dữ liệu xuống representation nhỏ gọn

- Decoder: Tái tạo lại dữ liệu gốc

Ứng dụng:

- Giảm nhiễu ảnh

- Phát hiện bất thường (anomaly detection)

- Nén dữ liệu

- Recommendation systems

🔑 Các khái niệm quan trọng

1. Activation Functions (Hàm kích hoạt)

Giúp model học các patterns phức tạp (non-linear):

ReLU (Rectified Linear Unit):

- Phổ biến nhất hiện nay

- Đơn giản:

f(x) = max(0, x) - Nhanh, hiệu quả

Sigmoid:

- Đầu ra trong khoảng (0, 1)

- Dùng cho binary classification

Tanh:

- Đầu ra trong khoảng (-1, 1)

- Tốt hơn Sigmoid một chút

Softmax:

- Dùng cho multi-class classification

- Chuyển output thành xác suất (tổng = 1)

2. Regularization (Chính quy hóa)

Vấn đề: Overfitting - Model “học vẹt” data training, kém với data mới

Giải pháp:

Dropout:

- Trong quá trình training, “tắt” random một số neurons

- Buộc model không phụ thuộc vào 1 neuron cụ thể

- Như sinh viên học nhóm: Không ai “gánh team” cả!

L1/L2 Regularization:

- Thêm “penalty” cho weights quá lớn

- Khuyến khích model đơn giản hóa

Data Augmentation:

- Tăng cường dữ liệu (xoay, lật, zoom ảnh)

- Model gặp nhiều biến thể → Tổng quát hóa tốt

3. Batch Normalization

Vấn đề: Dữ liệu qua nhiều lớp → Phân phối thay đổi → Khó học

Giải pháp: Chuẩn hóa dữ liệu sau mỗi lớp

- Mean = 0, Standard deviation = 1

- Model học nhanh hơn, ổn định hơn

4. Transfer Learning

Ý tưởng: Tận dụng model đã được train sẵn

Ví dụ:

- Model ImageNet (nhận diện 1000 loại vật) → Đã học features cơ bản (cạnh, texture)

- Bạn muốn nhận diện chó/mèo → Chỉ cần “fine-tune” lớp cuối

- Tiết kiệm thời gian, dữ liệu, và GPU!

Ứng dụng thực tế: Trong dự án Kanji của mình, mình đã thử transfer learning từ VGG16 nhưng cuối cùng train from scratch vẫn tốt hơn (vì chữ Kanji rất khác ảnh tự nhiên).

💡 Tại sao Deep Learning “bùng nổ” gần đây?

1. Big Data

Deep Learning cần rất nhiều dữ liệu:

- ImageNet: 14 triệu ảnh

- GPT-3: Được train trên 45TB text

- YouTube, Facebook, Instagram → Nguồn data khổng lồ

2. Computing Power

GPU (Graphics Processing Unit):

- Ban đầu dùng cho game

- Hoá ra cực kỳ phù hợp cho Deep Learning (tính toán song song)

- NVIDIA CUDA → Tăng tốc training lên hàng trăm lần

TPU (Tensor Processing Unit):

- Google phát triển riêng cho AI

- Nhanh hơn GPU nhiều lần

Cloud Computing:

- Thuê GPU trên AWS, Google Cloud

- Không cần đầu tư phần cứng đắt đỏ

3. Frameworks & Tools

TensorFlow (Google):

- Thư viện Deep Learning phổ biến nhất

- Hệ sinh thái đồ sộ

PyTorch (Facebook/Meta):

- Dễ học, dễ debug

- Được researchers yêu thích

Keras:

- High-level API, dễ sử dụng

- Chạy trên TensorFlow

Giờ đây, sinh viên như mình có thể build model Deep Learning chỉ với vài chục dòng code!

🚀 Ứng dụng thực tế của Deep Learning

1. Computer Vision (Thị giác máy tính)

Nhận diện đối tượng:

- Tesla Autopilot: Nhận diện người, xe, biển báo

- Camera an ninh: Phát hiện kẻ xâm nhập

Nhận diện khuôn mặt:

- Face ID trên iPhone

- Facebook tự tag bạn bè

Y tế:

- Phát hiện ung thư từ X-quang, CT scan

- Chẩn đoán võng mạc bệnh tiểu đường

2. Natural Language Processing (Xử lý ngôn ngữ)

Chatbots:

- ChatGPT, Bard, Claude

- Customer support tự động

Dịch máy:

- Google Translate

- DeepL

Phân tích cảm xúc:

- Phân tích review sản phẩm

- Theo dõi dư luận mạng xã hội

3. Speech Recognition (Nhận dạng giọng nói)

- Siri, Google Assistant, Alexa

- Phụ đề tự động YouTube

- Ghi chú giọng nói

4. Recommendation Systems (Hệ thống gợi ý)

- Netflix: Gợi ý phim

- Spotify: Gợi ý nhạc

- YouTube: Video tiếp theo

- Amazon: Sản phẩm liên quan

5. Game & Entertainment

Gaming AI:

- AlphaGo (đánh bại kỳ thủ Go)

- OpenAI Five (Dota 2)

- AlphaZero (cờ vua)

Tạo nội dung:

- DALL-E: Tạo ảnh từ text

- Midjourney: Nghệ thuật AI

- Stable Diffusion: Text-to-image

6. Autonomous Vehicles (Xe tự lái)

- Tesla Autopilot

- Waymo (Google)

- Cruise (GM)

Deep Learning xử lý:

- Nhận diện vật thể

- Dự đoán hành vi

- Lập kế hoạch đường đi

🎓 Kinh nghiệm học Deep Learning của mình

1. Nền tảng cần có

Math (Toán):

- Linear Algebra (Đại số tuyến tính): Ma trận, vector

- Calculus (Giải tích): Đạo hàm, chain rule (cho backpropagation)

- Probability (Xác suất): Phân phối, Bayes

Programming:

- Python (ngôn ngữ chính)

- NumPy (tính toán ma trận)

- Pandas (xử lý dữ liệu)

2. Lộ trình học tập

Phase 1: Foundation

- Machine Learning cơ bản (Andrew Ng - Coursera)

- Python & NumPy

- Linear Regression, Logistic Regression

Phase 2: Deep Learning Basics

- Neural Networks từ đầu (implement by hand)

- Hiểu Backpropagation

- Frameworks: TensorFlow/PyTorch

Phase 3: Advanced Topics

- CNN cho Computer Vision

- RNN/LSTM cho NLP

- Transfer Learning

Phase 4: Projects

- Làm project thực tế (như Kanji Recognition của mình)

- Kaggle competitions

- Đọc papers

3. Những sai lầm mình đã mắc phải

1. Bỏ qua math:

- Ban đầu mình nghĩ chỉ cần biết dùng framework

- Khi debug model, mới thấy math quan trọng thế nào!

2. Overfitting ngay từ đầu:

- Model training accuracy 99% nhưng test chỉ 70%

- Phải học cách regularization

3. Không theo dõi Loss:

- Training mãi không thấy cải thiện

- Sau mới biết learning rate quá cao

4. Data preprocessing kém:

- “Garbage in, garbage out”

- Chuẩn hóa data là bước quan trọng nhất

4. Tips hữu ích

✅ Bắt đầu từ đơn giản: Model nhỏ trước, rồi mới scale up

✅ Visualize everything: Loss curves, weights, activations

✅ Sử dụng pretrained models: Transfer learning tiết kiệm thời gian

✅ Join communities: Reddit, Discord, Kaggle

✅ Đọc papers: ArXiv, Papers with Code

✅ Practice coding: Implement từ scratch ít nhất 1 lần

🌟 Tương lai của Deep Learning

Những hướng nghiên cứu hot

1. Few-shot Learning:

- Model học từ vài ví dụ (thay vì hàng triệu)

- Con người học thế → AI nên học thế

2. Explainable AI (XAI):

- Hiểu tại sao model ra quyết định đó

- Quan trọng cho y tế, pháp lý

3. Neural Architecture Search (NAS):

- AI tự động thiết kế kiến trúc model

- Google AutoML

4. Federated Learning:

- Training model mà không cần data tập trung

- Bảo mật privacy tốt hơn

5. Quantum Machine Learning:

- Kết hợp Quantum Computing với ML

- Tiềm năng khổng lồ

Thách thức còn lại

❌ Interpretability: Model như “black box”

❌ Data bias: Model học thiên kiến từ data

❌ Energy consumption: Training GPT-3 thải CO₂ bằng 5 ô tô

❌ Safety & Ethics: Deepfake, AI vũ khí

❌ Hallucination: ChatGPT đôi khi “bịa” thông tin

🎯 Kết luận

Deep Learning không phải là “ma thuật” không thể hiểu được. Nó là:

- Chuỗi phép toán ma trận

- Thuật toán tối ưu hóa

- Rất nhiều dữ liệu

- Rất nhiều tính toán

- Và một chút “fine-tuning” nghệ thuật

Những điều mình học được sau 4 năm:

-

Deep Learning là công cụ, không phải giải pháp cho mọi thứ

- Đôi khi Linear Regression đơn giản là đủ

-

Data quan trọng hơn model

- Model phức tạp + data kém = Kết quả kém

- Model đơn giản + data tốt = Kết quả tốt

-

Hiểu sâu quan trọng hơn “dùng được”

- Biết “tại sao” → Debug nhanh, tối ưu tốt

-

Thực hành là chìa khóa

- Đọc 10 papers không bằng làm 1 project

-

Cộng đồng rất quan trọng

- Học lập trình AI không thể đơn độc

Lời kết

Nếu bạn cũng đang trên hành trình học Deep Learning, đừng nản chí khi gặp khó khăn. Mình cũng từng mất vài tuần chỉ để hiểu Backpropagation, vài tháng để model chạy đúng. Nhưng khi model cuối cùng đạt 99% accuracy, cảm giác đó không gì sánh bằng!

Resources mình recommend:

📚 Courses:

- Deep Learning Specialization (Andrew Ng)

- Fast.ai (Practical Deep Learning)

- Stanford CS231n (Computer Vision)

📖 Books:

- Deep Learning (Ian Goodfellow) - “Bible” của DL

- Hands-On Machine Learning (Aurélien Géron)

🌐 Websites:

- Papers with Code

- Distill.pub (giải thích visual cực đẹp)

- Kaggle Learn

Hi vọng bài viết giúp bạn hiểu hơn về Deep Learning! Nếu có câu hỏi hoặc muốn trao đổi thêm, hãy để lại comment nhé! Chúc bạn thành công trên con đường AI! 🚀

#DeepLearning #AI #MachineLearning #NeuralNetworks #StudentLife